Մ���Ƅ�(d��ng)�C(j��)��������ҵ�һӡ�����������(w��)�C(j��)��������(sh��)�H�ϟo(w��)���{���܇���������w�еğo(w��)�˙C(j��)�ȵȶ������Ƅ�(d��ng)�C(j��)���˷����������ܺ���һ���܉����ض��ĭh(hu��n)�����������ߣ��w�У�����ه�ڸ��ԵĶ�λ��(d��o)����·��Ҏ(gu��)���Լ����ϵȹ��ܣ���ҕ�X(ju��)�㷨�t�nj�(sh��)�F(xi��n)�@Щ�����P(gu��n)�I���g(sh��)��

�����(du��)�Ƅ�(d��ng)�C(j��)����ҕ�X(ju��)�㷨�M(j��n)�в�⣬��͕�(hu��)�l(f��)�F(xi��n)�@ȡ���w�����Ϣ����λ��(d��o)���Լ����ϵȶ��ǻ��ڲ�ͬ��ҕ�X(ju��)�㷨�����ľ͎������һ�ĎN��ͬ���ֱز����ٵ�ҕ�X(ju��)�㷨�M�ɡ�

�Ƅ�(d��ng)�C(j��)���˵�ҕ�X(ju��)�㷨�N�

��(w��n)����(sh��)�F(xi��n)��λ��(d��o)����·��Ҏ(gu��)���Լ����ϣ���ô�@Щ�^(gu��)������Ҫ��Щ�㷨��֧�֣�

Մ���Ƅ�(d��ng)�C(j��)���ˣ��ܶ����뵽������������@�ӵģ�“�٣����ܲ���ȥ��߅������һ�������F�^(gu��)��(l��i)��”�@��(g��) (t��ng)��ȥ��(du��)��ͨ�˺ܺ�(ji��n)�ε��΄�(w��)���ڙC(j��)���˵�������s��M�˸��N����(zh��n)����������@��(g��)�΄�(w��)���C(j��)����������Ҫ�d���܇��h(hu��n)���ĵ؈D�����_��λ�Լ��ڵ؈D�е�λ�ã�Ȼ�����(j��)�؈D�M(j��n)��·��Ҏ(gu��)�������Լ�����Ƅ�(d��ng)��

�����Ƅ�(d��ng)���^(gu��)���У��C(j��)����߀��Ҫ����(j��)�F(xi��n)��(ch��ng)�h(hu��n)�������S�����Ϣ����(sh��)�r(sh��)�Ķ���ϵK��ֱ�����_(d��)��KĿ��(bi��o)�c(di��n)�����@һ�B���C(j��)���˵�˼���^(gu��)���У����Էֽ�����ײ��ֵ�ҕ�X(ju��)�㷨��

1�������Ϣ��ȡ

2��ҕ�X(ju��)��(d��o)��

3��ҕ�X(ju��)����

�����҂���(hu��)Ԕ��(x��)�f(shu��)�@Щ�㷨�����@Щ�㷨�Ļ��A(ch��)���ǙC(j��)�����X���ϵ�ҕ�X(ju��)��������

ҕ�X(ju��)�㷨�Ļ��A(ch��)��������

��(w��n)�������֙C(j��)�ϵĔz���^��������C(j��)���˵��۾��

����ҕ�X(ju��)�㷨�Ļ��A(ch��)�f(shu��)���ׁ�(l��i)���ڙC(j��)�����X���ϵ�ҕ�X(ju��)���������ͺñ��˵��۾���ҹ�gҕ���dz��õĄ�(d��ng)����ȣ����F(xi��n)����(l��i)�ĸ�֪��������ȫ��ͬ�ġ�ͬ�ӵģ�һ��(g��)�۾��Ą�(d��ng)�(du��)����ĸ�֪����ҲҪ���ڃɂ�(g��)�۾��Ą�(d��ng)�ÿ��(g��)�����е������֙C(j��)�z���^�䌍(sh��)�Ϳ�������C(j��)���˵��۾�����(d��ng)�·dz����е�Pokeman Go�Α��ʹ����Ӌ(j��)��C(j��)ҕ�X(ju��)���g(sh��)��(l��i)�_(d��)��AR��Ч����

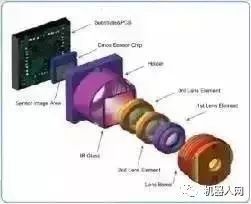

���ψD��(hu��)���ǘӣ�һ��(g��)�����֙C(j��)�Дz���^ģ�M�����(n��i)���������ׂ�(g��)��Ҫ�ĽM�����R�^��IR filter��CMOS sensor�������R�^һ���ɔ�(sh��)Ƭ�RƬ�M�ɣ���(j��ng)�^(gu��)��(f��)�s�Ĺ�W(xu��)�O(sh��)Ӌ(j��)���F(xi��n)�ڿ��������r(ji��)�Ę�(sh��)֬���ϣ����������|(zh��)���dz��õ��֙C(j��)�z���^��

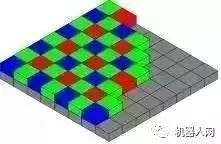

CMOS sensor�����(hu��)���w������Bayer��ɫ�V����еĞVɫƬ��ÿ��(g��)��ͬ�ɫ�ĞV��Ƭ������ͨ�^(gu��)�ض��ĹⲨ���L(zh��ng)����(du��)��(y��ng)CMOS�й������ϾͿ����ڲ�ͬλ�÷քe�@�ò�ͬ�ɫ�Ĺ⏊(qi��ng)�ˡ����CMOS�������ķֱ�����4000x3000�����˵õ�ͬ�ӷֱ��ʵ�RGB��ɫ�ĈD����Ҫ��һ�N����demosaicing��Ӌ(j��)��z���㷨����2�G1�{(l��n)1�t��2x2�W(w��ng)���н����2x2��RGB��Ϣ��

һ���CMOS�й����Գ����x��t�G�{(l��n)��ɫ֮�⣬��(du��)�ڼt��������ġ�����ڹ�·�м���IR�V��Ƭ���Ǟ���ȥ��̫�(y��ng)�⾀�мt��⌦(du��)CMOS�ĸɔ_�����ϞV��Ƭ��ͨ���D��Č�(du��)�ȶȕ�(hu��)�õ��@����������

��(w��n)��Ӌ(j��)��C(j��)ҕ�X(ju��)��߀��(hu��)�õ�ʲô��������

����RGB���C(j��)��Ӌ(j��)��C(j��)ҕ�X(ju��)�г��õ�߀�������N��������C(j��)��������һ�N���C(j��)�ĞV��Ƭ��ֻ���Sͨ�^(gu��)�t��Ⲩ�εġ���?y��n)�����ͨ���ǿ����?ji��n)�t���ģ����Կ��������C(j��)������������(d��ng)�t���Դ�����ڜy(c��)�����(y��ng)����

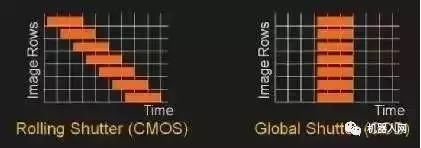

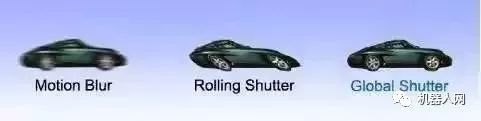

���⣬���҂��õ���camera������rolling shutter����ʽ��(sh��)�F(xi��n)����ع�ģ���D�����(c��)�ǘӣ����˜p����������ijɱ����ع�ͨ����һ��һ�зքe�M(j��n)�У��@�ӄ�(sh��)��������w�����Ƅ�(d��ng)�r(sh��)�����C(j��)�ɼ����ĈD���(hu��)�l(f��)����׃�����˱����@�N��׃��(du��)�������w���M(j��n)��Ӌ(j��)���ҕ�X(ju��)�㷨��Ӱ푣�����VSLAM�����x��global shutter�����C(j��)���@���e��Ҫ�ˡ�

������C(j��)����һ���ҕ�X(ju��)�㷨����Ҫ�Ă����������Էֳ������

1��TOF������������Kinect 2������������x(ch��ng)��(f��)�ۡ��ɱ��ߣ��������ʹ�á�

2���Y(ji��)��(g��u)�������������Kinect 1���������Ƕ�λԭ�����ɱ��У����ⲻ���á�

3���pĿҕ�X(ju��)������Intel Realsense R200��������(d��ng)������(d��ng)������IR���Ҋ(ji��n)��Կɡ��ɱ��ͣ��������ʹ�á�

�㷨һ�������Ϣ��ȡ

��(w��n)��������C(j��)����R(sh��)�e���w�������Ϣ���أ�

��(ji��n)����֮����ԭ������ʹ�Ãɂ�(g��)ƽ�е����C(j��)����(du��)���g�е�ÿ��(g��)�c(di��n)���Ƕ�λ��ͨ�^(gu��)ƥ�����҃ɂ�(g��)���C(j��)�г����c(di��n)��λ�ã���(l��i)Ӌ(j��)�㌦(du��)��(y��ng)���S�c(di��n)�ڿ��g�еľ��x���W(xu��)�g(sh��)�猦(du��)�pĿƥ��֏�(f��)��ȈD�о��к��L(zh��ng)�Ěvʷ����NASA����܇�Ͼ��_(k��i)ʼ�����@��(g��)���g(sh��)�����������������M(f��i)���Ʒ�Ј�(ch��ng)�õ��V����(y��ng)��߀�Ǐ�ܛ��Kinect�w�Ђ������_(k��i)ʼ��

Kinect����������ʹ������ɫ��Primesense��˾�ڙ�(qu��n)�ĽY(ji��)��(g��u)�⼼�g(sh��)������ѱ�Apple��ُ(g��u)������ԭ���DZ��_(k��i)�pĿƥ���Џ�(f��)�s���㷨�O(sh��)Ӌ(j��)���D(zhu��n)����һ��(g��)�z���^���Q����������(d��ng)Ͷ���(f��)�s��ߵļt��ͶӰ�x������һ��(g��)ƽ��λ�õ����C(j��)Ҳ׃���˼t�����C(j��)����������Ŀ���ͶӰ�xͶ������й�ߡ���?y��n)����ۿ������t���ߣ����Ҽy���dz���(f��)�s���@�ͷdz��������pĿƥ���㷨�������÷dz���(ji��n)�����㷨���R(sh��)�e�������Ϣ��

�M��Kinect�ă�(n��i)��ԭ���ٷ����](m��i)�нo����ጣ��ڽ����(l��i)һƪKinect Unleashed�������У�������hack���@��(g��)ϵ�y(t��ng)�Ĺ���ԭ����

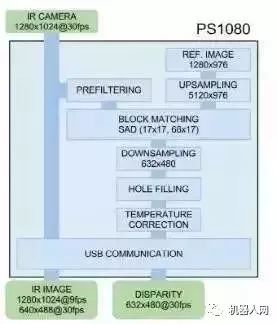

���ȣ��t��D���ڻ��������ϲɘ�8�����@�ӿ��Ա��C�����pĿƥ���(sh��)�F(xi��n)3bit�ā����ؾ��ȡ�Ȼ��(du��)�D����sobel�V����ʹ�ÈD���ƥ�侫����ߡ����D���c�A(y��)���ͶӰ���ģ��D���M(j��n)��SAD block matching��ԓ�㷨��Ӌ(j��)���(f��)�s��С���m��Ӳ���Ͳ��С����(j��ng)�^(gu��)��(ji��n)�εĈD���̎�����²ɘӵ�ԭʼ�ֱ��ʣ��õ���K����ȈD��

�҂����Կ������S��2009��Kinect�O(sh��)�������M(f��i)�C(j��)�Ј�(ch��ng)�ı��l(f��)���l(f��)���^10��100�f(w��n)�_(t��i)������u�_(k��i)ʼ��������Ƽ��g(sh��)׃�N���Ƅ�(d��ng)���O(sh��)����аl(f��)�ᳱ����2013�������S��Ӌ(j��)���������������㷨���M(j��n)����Ӳ���ɱ����͵�����(d��ng)������(d��ng)�pĿ������C(j��)�_(k��i)ʼ���Ƅ�(d��ng)�֙C(j��)��ӿ�F(xi��n)��

�^(gu��)ȥ�J(r��n)����y��(sh��)�r(sh��)�\(y��n)�е��pĿƥ���㷨����ʹ�ڛ](m��i)������(d��ng)�Y(ji��)��(g��u)���o������r�£�Ҳ���F(xi��n)���dz���(y��u)����3D�����|(zh��)����SegwayRobot����������(d��ng)������(d��ng)���ГQ���pĿ���ҕ�X(ju��)ϵ�y(t��ng)�����D��ʾ�����(c��)����(g��)�������քe�飬��t�����C(j��)���t��patternͶӰ���Ҽt�����C(j��)�����҃�(n��i)�����r(sh��)����?y��n)�t���Դ���㣬�t��ͶӰ���_(k��i)���o���pĿƥ���㷨����������r(sh��)���t���Դ���㣬�t��ͶӰ�P(gu��n)�]���pĿƥ���㷨����ֱ���\(y��n)�С��C�Ͽ�����ϵ�y(t��ng)���҃�(n��i)�ⶼ���F(xi��n)����(y��u)������Ȃ���������

�㷨������λ��(d��o)��

��(w��n)��ҕ�X(ju��)̎���C(j��)��������Ό�(sh��)�F(xi��n)��(d��o)���ģ�

�C(j��)���ˌ�(d��o)��������һ��(g��)���^��(f��)�s��ϵ�y(t��ng)�������漰���ļ��g(sh��)��(hu��)�������б���

ҕ�X(ju��)���Ӌ(j��) VO

���D������VO����ȈD

�ض�λ������֪�؈D���R(sh��)�e��(d��ng)ǰ��λ��

�]�h(hu��n)�z�y(c��)·������VO���]�h(hu��n)�`��

ȫ��(d��o)��

ҕ�X(ju��)����

Scene tagging���R(sh��)�e���g�����w����tag

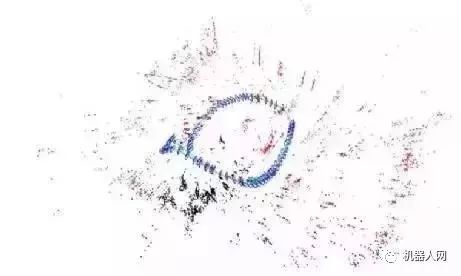

�C(j��)�����_(k��i)�C(j��)��ҕ�X(ju��)���Ӌ(j��)�͕�(hu��)�_(k��i)ʼ������ӛ䛏��_(k��i)�C(j��)λ�����6DOF��λ��Ϣ���ڙC(j��)�����\(y��n)��(d��ng)�^(gu��)���У�mapping�㷨�_(k��i)ʼ��(g��u)���C(j��)���˿��������磬�����g���S���������c(di��n)��Ϣ�����S�ĵ؈D��Ϣӛ䛵��C(j��)����map�С�

��(d��ng)�C(j��)�����\(y��n)��(d��ng)�^(gu��)������?y��n)��ړ�����늵�ԭ��Gʧ������������(bi��o)���ض�λ�㷨����Ҫ����֪�؈D�ж�λ���C(j��)���ˮ�(d��ng)ǰ��λ�ù�Ӌ(j��)�����⣬��(d��ng)�C(j��)�����\(y��n)��(d��ng)�лص��˵؈D������(j��ng)���F(xi��n)�^(gu��)��λ�ã�����ҕ�X(ju��)���Ӌ(j��)��ƫ���(hu��)��(d��o)��܉�E���](m��i)����ȫ�]�ϣ��@����Ҫ�]�h(hu��n)�㷨�z�y(c��)�ͼm���@��(g��)�e(cu��)�`��

����ȫ�ֵ؈D֮�C(j��)���˾Ϳ��Խo��һЩĿ��(bi��o)�c(di��n)ָ���ȫ�ֵ�������(d��o)���ˡ��ڬF(xi��n)��(sh��)�У���?y��n)�h(hu��n)���Dz�ͣ׃���ģ�ȫ�ֵ؈D��������ȫ��ӳ��(d��o)���r(sh��)���ϵK���r��KUKA�C(j��)���˾S���������Ҫ���{��ȫ��(d��o)��֮�ϵ�ҕ�X(ju��)�����㷨�M(j��n)�Ќ�(sh��)�r(sh��)���\(y��n)��(d��ng)�{(di��o)����

���һ��(g��)�Ԅ�(d��ng)�Č�(d��o)��ϵ�y(t��ng)߀��Ҫ�C(j��)�����Ԅ�(d��ng)�R(sh��)�e��������g�еIJ�ͬ���w����Ϣ��λ�á��߶Ⱥʹ�С���@Щtag��Ϣ�B���ڵ؈D�ϣ��C(j��)���˾Ϳ��ԏ��Z(y��)�x�������Լ���̎�ĭh(hu��n)�������Ñ�Ҳ���ԏĸ��ߌӴ����_(d��)һЩָ�

��(w��n)��ҕ�X(ju��)VSLAM�ڙC(j��)�����ϵČ�(sh��)�F(xi��n)����Щ�y�c(di��n)��

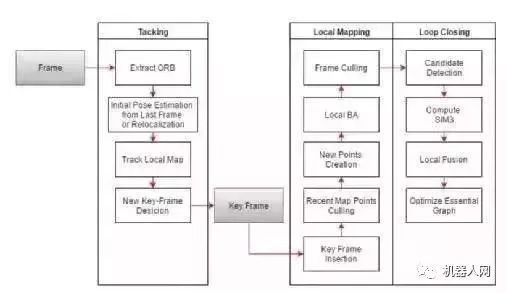

ҕ�X(ju��)VSLAM��һ��(g��)������ҕ�X(ju��)���Ӌ(j��)�����D�����ض�λ���㷨ϵ�y(t��ng)�������(l��i)�l(f��)չ�ܿ졣����������ҕ�X(ju��)SLAM�㷨�Ľ�(j��ng)���PTAM�㷨�_(k��i)�ˣ�Ŀǰ��O(sh��)RB��SLAM��������㷨�ѽ�(j��ng)������PC���_(d��)����(sh��)�r(sh��)�\(y��n)�С�������һ��(g��)ORBSLAM�Ŀ�D��

�����ֿ�Ҋ(ji��n)����ʹ��ORB����D��������ȡ���ߣ������ں��m(x��)�Ľ��D���ض�λ�о�ʹ����ͬһ�������c(di��n)��Ϣ������(du��)�ڂ��y(t��ng)��SIFT��SURF������ȡ�㷨����Ч�ʸ߳��ܶࡣ

ORB��SLAM��������(g��)���еľ��̣�����ۙ�����D���]�h(hu��n)�����и�ۙ�����\(y��n)����ǰ�ˣ����C��(sh��)�r(sh��)�\(y��n)�У����D���]�h(hu��n)�����\(y��n)���ں�ˣ��ٶȲ���Ҫ��(sh��)�r(sh��)�������c��ۙ���̹���ͬһ�ݵ؈D��(sh��)��(j��)�������ھ�����ʹ�õ؈D��(sh��)��(j��)���Ⱥ�ۙ���ȸ��ߡ��D��ORB��SLAM�؈D����Ҫ��(sh��)��(j��)�Y(ji��)��(g��u)��

�c(di��n)�ƺ��P(gu��n)�I��������֮�gͨ�^(gu��)�D����2D�����c(di��n)�c���g�е��c(di��n)�ƽ���ӳ���P(gu��n)ϵ��ͬ�r(sh��)߀�S�o(h��)���P(gu��n)�I��֮�g��covisibility graph�P(gu��n)ϵ��ͨ�^(gu��)�@Щ��(sh��)��(j��)�P(gu��n)(li��n)���Ã�(y��u)��������(l��i)�S�o(h��)����(g��)�؈D��

ORB��SLAM�ڙC(j��)�����ϑ�(y��ng)����Ȼ���������y�c(di��n)��

1��Ӌ(j��)�����^(gu��)����4��̎������ͨ����(hu��)ռȥ60������CPU�YԴ��

2���ڙC(j��)�����\(y��n)��(d��ng)�^(gu��)��r(sh��)��(hu��)���F(xi��n)���G���ɏ�(f��)ԭ����r��

3����ĿSLAM���ڳ߶Ȳ��_���Ć�(w��n)�}���ڙC(j��)���˿������D(zhu��n)�r(sh��)���ˆ�(w��n)�}�������@���ܿ��(hu��)���F(xi��n)�]�h(hu��n)�`���^(gu��)��o(w��)���m������r��

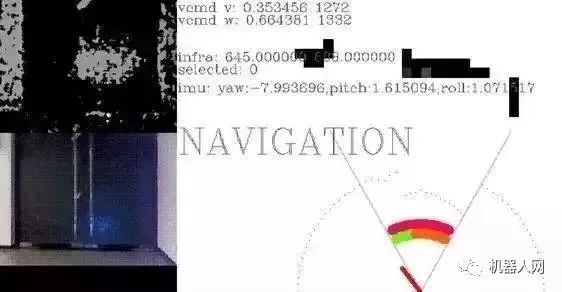

ᘌ�(du��)�߶Ȇ�(w��n)�}���ЃɷN������Q������һ��(g��)�z���^�γ��pĿSLAMϵ�y(t��ng)����������һ��(g��)IMU�γ�����ϣ��o��ϵ�ҕ�X(ju��)�T��(d��o)��λϵ�y(t��ng)���@�ﺆ(ji��n)�ν�B����ϵ�ҕ�X(ju��)�T��(d��o)��λϵ�y(t��ng)��һ���VSLAM��(d��ng)��һ��(g��)�ں��ӣ������ݔ�������^�y(c��)���ŵ�һ��(g��)����IMU��EKFϵ�y(t��ng)�У�EKF��Kfuse��ݔ������ϵ�y(t��ng)��ݔ����

���]��camera��(sh��)��(j��)��IMU��(sh��)��(j��)ͨ���Dz�ͬ���ģ����ͨ�^(gu��)Ӳ���r(sh��)�g����KUKA�C(j��)���˾S������Ҫ�Д��D��(sh��)��(j��)��(du��)��(y��ng)�ĕr(sh��)�g���cIMU�r(sh��)�g�����P(gu��n)ϵ����EKF propagate���E�����ߎ��ʵ�IMU��(sh��)��(j��)��ͣ�ĸ���EKF�Ġ�B(t��i)����camera��(sh��)��(j��)����(l��i)�r(sh��)���|�l(f��)EKF update���E������(j��)EKF��ģ���́�(l��i)����?t��ng)�B(t��i)׃�����f(xi��)�����ꇣ��������¸�����������camera��(sh��)��(j��)��IMU��(sh��)��(j��)��(du��)��(y��ng)�Ġ�B(t��i)׃����

SegwayRobot�����˘I(y��)���I(l��ng)�ȵ�ҕ�X(ju��)�T��(d��o)��λϵ�y(t��ng)��������һ��(g��)�ژǵ������\(y��n)��һȦ���ص�ԭ�c(di��n)֮���Ч���D�����w������(y��u)��(sh��)��

1���ڴ�߶��¿��Ա��C�dz�С���]�h(hu��n)�`��

2����(sh��)�r(sh��)�\(y��n)�У�����CPU�YԴС

3�����S�������D(zhu��n)��������(k��)���C(j��)�����(q��)��(d��ng)���S��������(hu��)���G

�㷨��������

��(w��n)��ҕ�X(ju��)���ϵ��㷨ԭ�������ӵģ�

��(d��o)����Q�Ć�(w��n)�}������(d��o)�C(j��)���˽ӽ�Ŀ��(bi��o)����(d��ng)�C(j��)���˛](m��i)�е؈D�ĕr(sh��)�ӽ�Ŀ��(bi��o)�ķ����Q��ҕ�X(ju��)���ϼ��g(sh��)�������㷨��Q�Ć�(w��n)�}�Ǹ���(j��)ҕ�X(ju��)�������Ĕ�(sh��)��(j��)����(du��)�o�B(t��i)�ϵK���(d��ng)�B(t��i)�ϵK�(sh��)�F(xi��n)��ܣ����ԾS����Ŀ��(bi��o)�����\(y��n)��(d��ng)����(sh��)�r(sh��)������(d��o)����

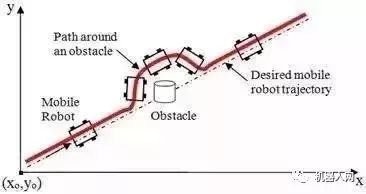

�����㷨�кܶ࣬Ȼ���@Щ�������Ї�(y��n)��ļ��O(sh��)�����O(sh��)�ϵK���A�λ���O(sh��)�C(j��)���˞�A�Σ����O(sh��)�C(j��)���˿������ⷽ���\(y��n)��(d��ng)��s����O(sh��)��ֻ���߈A��·����Ȼ����(sh��)�H��(y��ng)���ϣ��C(j��)���˺��y�_(d��)���l��������VFF�㷨�� ԓ�㷨���O(sh��)�C(j��)���˞��c(di��n)�����ҿ������ⷽ���\(y��n)��(d��ng)��VFH�����O(sh��)�C(j��)���˞�A�Σ�ͨ�^(gu��)�A����Û�ϵK��ڿ��]�\(y��n)��(d��ng)�W(xu��)��(w��n)�}�r(sh��)�H�H���O(sh��)�C(j��)�����ԈA��·���\(y��n)��(d��ng)��DWAҲ���O(sh��)�C(j��)���˞�A�Σ��ڿ��]�\(y��n)��(d��ng)�W(xu��)��(w��n)�}�r(sh��)ֻģ�M��ǰ��A���\(y��n)��(d��ng)�r(sh��)����r��

����(du��)���ԣ��҂������ƙC(j��)���˵��Π���]�\(y��n)��(d��ng)�W(xu��)��(w��n)�}�r(sh��)��ģ�M��N�\(y��n)��(d��ng)ģ�ͣ��������ڈA���\(y��n)��(d��ng)����?y��n)��@�ӿ��Ԟ�C(j��)�����ҵ����ѱ��_(k��i)�ϵK����О顣

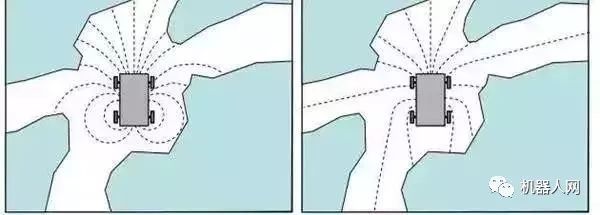

�@���D�@ʾ��ʹ�ò�ͬ�\(y��n)��(d��ng)�W(xu��)ģ�͌�(d��o)�²�ͬ�ı��ϽY(ji��)������D��ʾʹ�ÈA��ģ�͕r(sh��)ģ�M��·�����҈D��ʾʹ����һ�N·��ģ��ģ�M��·�������@�N�MС�h(hu��n)�����˷���������ǰ�A(y��)�y(c��)����(g��)������ϵK����r���x����m��ģ�Ϳ��Ԏ����ҵ������m���\(y��n)��(d��ng)�������ϵK�

��Ŀǰ���õı����㷨֮�g���ڵIJ���ڣ������\(y��n)��(d��ng)�W(xu��)ģ�ͳ����܇��h(hu��n)���؈D�У�Ȼ��Ϳ���ʹ���κγ��õı����㷨���@�Ӿͽ������\(y��n)��(d��ng)�W(xu��)ģ���c�㷨�������������κ�Ҫ���(y��n)��ı����㷨���ܼ����M(j��n)��(l��i)��SegwayRobot�ı���ϵ�y(t��ng)���C������Ȃ�������������IMU��sensor���ڏ�(f��)�s�ĭh(hu��n)���У������������ϵK�

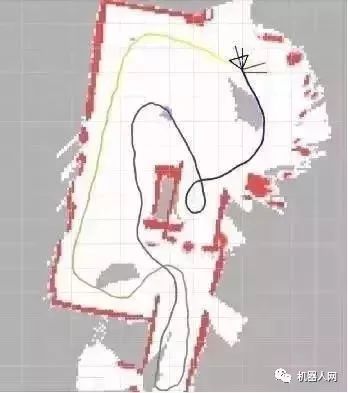

�@���D���҂��ı���ϵ�y(t��ng)��һ��(g��)�؈D�����Կ�����ȈD��2�S�ı��ϵ؈D��������tɫ��ָᘾʹ�����ÿ�r(sh��)ÿ�̱��ϵěQ�ߡ�

���ʆ�(w��n)��

Q����ʲô�x��ir���C(j��)�����ǂ��y(t��ng)��rgb���C(j��)�أ�ir���C(j��)����(du��)��(l��i)�v�ă�(y��u)��(sh��)�����

A��ir���C(j��)���Կ������ۿ����������w������������C(j��)��Ҫ���҃�(n��i)Ͷ��t��y������������R(sh��)�e�����ۿ���������ir���C(j��)���Կ���

Q���F(xi��n)�ڙC(j��)���ˌ�(d��o)���Ƿ���Ҫ��slam���g(sh��)��߀�Л](m��i)������(d��o)�����g(sh��)����Ҫ���е�slam���g(sh��)����Щ�������o(w��)���{��͟o(w��)�˙C(j��)��ҕ�X(ju��)��(d��o)�����g(sh��)����Щ��ͬ��

A��slam���g(sh��)�nj�(d��o)���е�һ��(g��)���A(ch��)ģ�K���Nܶ࣬�І�Ŀ���pĿ��depth��imu��ҕ�X(ju��)�Ȃ���������A(ch��)���㷨���pĿ���C(j��)���Ժܺõ��m��(y��ng)�҃�(n��i)������ĭh(hu��n)���������w�e�䌍(sh��)�dz�С��segwayRobotʹ�õ�camera�L(zh��ng)����10cm����

Q���F(xi��n)���Пo(w��)���ڙC(j��)���ˌ�(d��o)���Č�(d��o)���؈D���ڣ����܇�d��(d��o)���؈D�����ڙC(j��)���ˌ�(d��o)���ĵ؈D��(sh��)��(j��)����Щ��